⚡ En bref

LangChain est le framework open source de référence pour construire des applications IA basées sur des LLMs.

Ses composants clés — Chains, Agents, RAG et mémoire — permettent de créer des automatisations métier avancées.

LangGraph (graphes d’états) et LangChain sont complémentaires ; CrewAI et AutoGen s’adressent à des besoins différents.

Combiné à Mistral AI, LangChain permet de déployer une IA souveraine et conforme au RGPD en France.

Des plateformes comme Agentsia.fr industrialisent LangChain pour les entreprises sans équipe data interne.

Sommaire

- Qu’est-ce que LangChain ?

- Les composants clés de LangChain

- LangChain vs LangGraph vs CrewAI vs AutoGen

- Le RAG avec LangChain : architecture et exemple de code

- LangChain + Mistral AI : l’angle souveraineté pour les entreprises françaises

- Cas d’usage concrets et chiffrés en entreprise

- LangChain avec n8n et Make : le pont vers l’automatisation no-code

- Coût et hébergement d’un agent LangChain en entreprise

- Comment Agentsia.fr industrialise LangChain pour vous

- FAQ

Qu’est-ce que LangChain ?

Vous avez entendu parler de ChatGPT, de Mistral ou de Claude. Mais vous vous demandez comment ces modèles de langage peuvent réellement s’intégrer dans vos processus métier — et pas seulement répondre à des questions dans une interface de chat. C’est exactement le problème que LangChain résout.

LangChain est un framework open source lancé en 2022 par Harrison Chase. Son objectif : fournir aux développeurs les briques nécessaires pour construire des applications IA complexes autour des grands modèles de langage (LLM). En clair, LangChain est la « colle » qui permet à un LLM de lire vos documents internes, d’appeler vos APIs, de mémoriser des conversations et d’enchaîner des actions de façon autonome.

Définition : LangChain est un framework Python (et JavaScript) qui orchestre les interactions entre un LLM et des sources de données externes, des outils et des agents autonomes pour créer des applications IA contextuelles et actionnables.

En 2026, LangChain est devenu le standard de facto de l’industrie avec plus de 90 000 étoiles sur GitHub et une adoption massive par les équipes techniques des entreprises du CAC 40 comme des PME innovantes. Ce n’est pas un gadget : c’est l’infrastructure sur laquelle repose la majorité des projets d’IA générative en production.

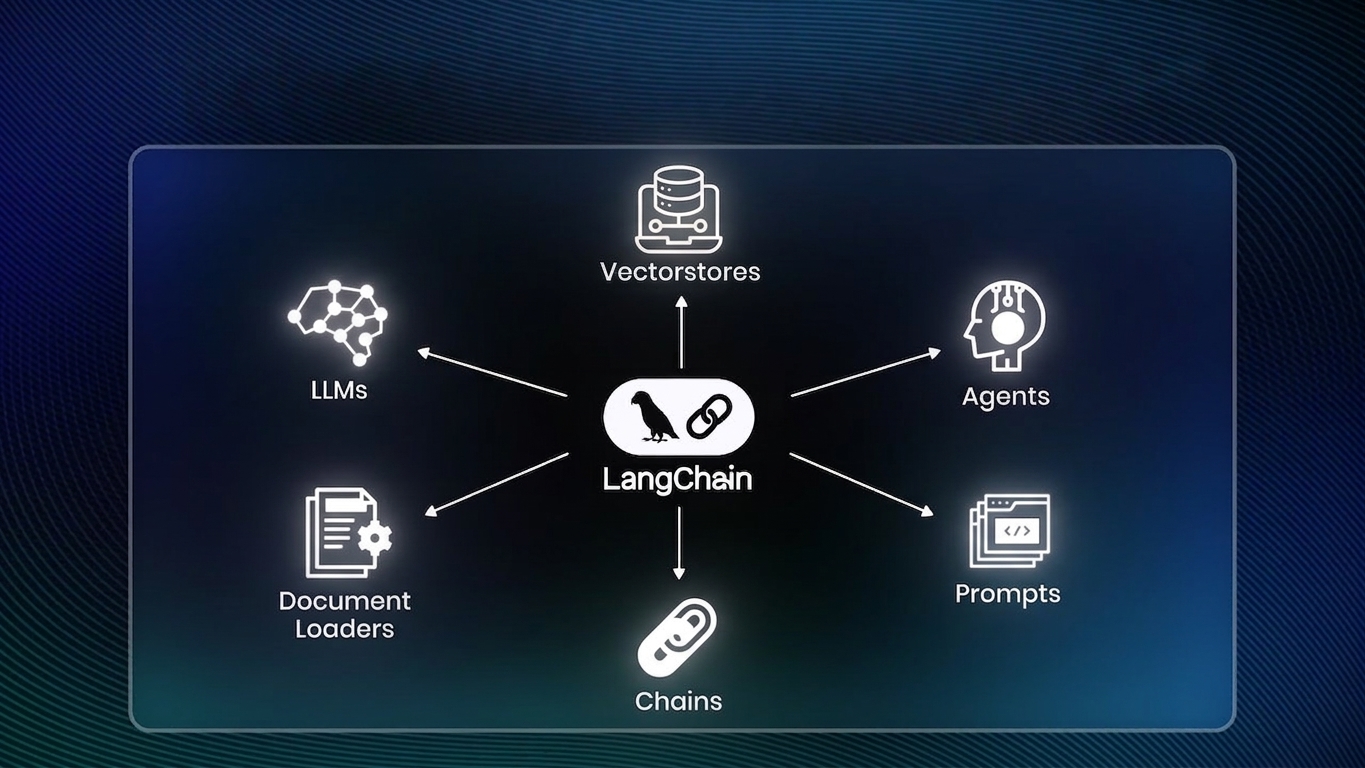

Les composants clés de LangChain

LangChain s’articule autour de cinq briques fondamentales. Comprendre chacune d’elles, c’est comprendre pourquoi ce framework s’est imposé comme la référence.

Chains : enchaîner les actions

Une Chain est une séquence d’opérations appliquées dans un ordre défini. Par exemple : « récupère ce document PDF → résume-le → traduis le résumé → envoie-le par email. » Chaque étape est un maillon de la chaîne. LangChain gère les entrées/sorties entre chaque maillon automatiquement, ce qui élimine des dizaines de lignes de code répétitif.

Agents : décider et agir de façon autonome

Un Agent va plus loin qu’une Chain : il choisit lui-même les outils à utiliser en fonction de l’objectif qu’on lui donne. Vous lui dites « analyse les ventes du dernier trimestre et identifie les anomalies » — il décide seul s’il doit interroger votre base de données, appeler une API ou générer un graphique. Les agents LangChain utilisent des boucles de raisonnement de type ReAct (Reason + Act) pour prendre ces décisions.

Mémoire : donner du contexte à vos IA

Sans mémoire, un LLM oublie tout à chaque nouvelle requête. LangChain propose plusieurs types de mémoire :

- ConversationBufferMemory : conserve l’intégralité de l’historique

- ConversationSummaryMemory : résume les échanges passés pour économiser les tokens

- VectorStoreMemory : stocke les informations dans une base vectorielle pour une récupération sémantique

Pour les entreprises, la mémoire persistante des agents IA est un enjeu critique : elle permet à un agent de se souvenir des préférences d’un client, de l’historique d’un dossier ou des décisions passées d’un manager.

RAG (Retrieval-Augmented Generation)

Le RAG est la fonctionnalité la plus utilisée en entreprise. Elle permet au LLM de répondre à des questions en s’appuyant sur vos propres données (contrats, manuels, bases de connaissance) plutôt que sur ses seules données d’entraînement. Voir la section dédiée ci-dessous.

Connecteurs et outils (Tools)

LangChain s’intègre nativement avec des centaines d’outils : bases de données SQL, Notion, Slack, Google Drive, APIs REST, Salesforce, etc. Ces connecteurs permettent à vos agents de lire et d’écrire dans vos systèmes existants sans développement sur mesure.

LangChain vs LangGraph vs CrewAI vs AutoGen

C’est la question que posent le plus souvent les équipes techniques avant de démarrer un projet. Voici un comparatif objectif des quatre frameworks les plus utilisés en 2026.

| Critère | LangChain | LangGraph | CrewAI | AutoGen |

|---|---|---|---|---|

| Cas d’usage principal | Applications LLM généralistes | Workflows à états complexes | Multi-agents collaboratifs | Agents conversationnels |

| Courbe d’apprentissage | Modérée | Élevée | Faible | Modérée |

| Flexibilité | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ |

| Production-ready | ✅ | ✅ | ⚠️ | ⚠️ |

| Communauté | Très grande | Grande | Moyenne | Moyenne |

| Compatibilité RGPD | À configurer | À configurer | À configurer | À configurer |

| Idéal pour | Tout type de projet IA | Processus métier complexes | Équipes d’agents spécialisés | Automatisation conversationnelle |

LangGraph est en réalité une extension de LangChain, développée par la même équipe. Il introduit une abstraction de graphe orienté pour modéliser des workflows où les agents peuvent boucler, bifurquer ou attendre une validation humaine. C’est le choix privilégié pour les processus métier complexes (approbation de devis, gestion d’incidents).

CrewAI brille pour les scénarios où plusieurs agents spécialisés collaborent : un agent « chercheur », un agent « rédacteur » et un agent « critique » qui travaillent ensemble sur une tâche. Mais il reste moins mature en production que LangChain.

AutoGen (Microsoft) est orienté conversations multi-agents. Puissant pour les scénarios de type « chatbot d’entreprise », mais moins adapté aux pipelines de traitement de données.

Notre recommandation : commencez avec LangChain. Si vos workflows nécessitent des états complexes et des boucles de validation humaine, ajoutez LangGraph. Évitez de disperser vos efforts sur plusieurs frameworks simultanément.

Le RAG avec LangChain : architecture et exemple de code

Le Retrieval-Augmented Generation est la technique qui permet à votre IA de répondre à des questions en puisant dans vos documents internes. Voici comment il fonctionne architecturalement :

[Documents internes]

↓

[Découpage en chunks]

↓

[Vectorisation (embeddings)]

↓

[Stockage dans une base vectorielle (ex: Chroma, Pinecone, pgvector)]

↓

[Requête utilisateur] → [Récupération des chunks pertinents] → [LLM] → [Réponse contextualisée]

Voici un exemple de code Python simplifié pour un RAG avec LangChain et Mistral AI :

from langchain_community.document_loaders import PyPDFLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

from langchain_community.vectorstores import Chroma

from langchain_mistralai import MistralAIEmbeddings, ChatMistralAI

from langchain.chains import RetrievalQA

# 1. Chargement du document

loader = PyPDFLoader("contrat_client.pdf")

documents = loader.load()

# 2. Découpage en chunks

splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=200)

chunks = splitter.split_documents(documents)

# 3. Vectorisation et stockage (avec Mistral Embeddings)

embeddings = MistralAIEmbeddings(model="mistral-embed")

vectorstore = Chroma.from_documents(chunks, embeddings)

# 4. Création du pipeline RAG

llm = ChatMistralAI(model="mistral-large-latest")

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

retriever=vectorstore.as_retriever(search_kwargs={"k": 4})

)

# 5. Interrogation

response = qa_chain.invoke("Quelles sont les conditions de résiliation ?")

print(response["result"])

Ce pipeline peut être déployé en production pour interroger des centaines de documents en quelques secondes. La documentation officielle LangChain propose des guides complets pour chaque étape de ce processus.

LangChain + Mistral AI : l’angle souveraineté pour les entreprises françaises {#mistral}

C’est l’un des différenciateurs les plus importants pour les entreprises françaises en 2026 : la souveraineté des données.

Utiliser LangChain avec GPT-4 (OpenAI) signifie que vos données transitent par des serveurs américains. Pour les données sensibles — contrats, données RH, informations clients — c’est souvent incompatible avec votre politique de sécurité et vos obligations RGPD.

La combinaison LangChain + Mistral AI change la donne :

- Mistral AI est une entreprise française dont les modèles (Mistral Large, Mistral Small, Mixtral) peuvent être déployés on-premise ou sur des serveurs européens

- LangChain supporte nativement Mistral via le package

langchain-mistralai - Vous gardez le contrôle total de vos données : rien ne sort de votre infrastructure

- La France et l’Allemagne ont d’ailleurs officiellement adopté Mistral AI pour leurs administrations publiques

Pour les secteurs réglementés (santé, finance, assurance, administration), cette architecture est souvent la seule acceptable. C’est aussi un argument commercial fort : vos clients et partenaires savent que leurs données restent en France.

Cas d’usage concrets et chiffrés en entreprise

Automatisation du service client : -40% de tickets traités manuellement

Un agent LangChain connecté à votre base de connaissance et à votre CRM peut traiter automatiquement 60 à 70% des demandes entrantes de niveau 1 (questions fréquentes, suivi de commande, demandes de remboursement simples). Les équipes support se concentrent sur les cas complexes à valeur ajoutée. Résultat constaté chez nos clients : réduction de 40% du volume de tickets traités manuellement en 3 mois.

Analyse de documents complexes : de 4h à 8 minutes

Un cabinet d’avocats ou un département juridique reçoit des centaines de contrats à analyser. Un pipeline RAG LangChain peut extraire automatiquement les clauses clés, identifier les risques et générer un résumé structuré. Ce qui prenait 4 heures à un juriste junior se fait en 8 minutes, avec un taux d’erreur inférieur à celui de l’humain sur les tâches répétitives.

Agent d’aide à la décision pour le management

Connecté à vos données ERP, CRM et tableaux de bord, un agent LangChain peut répondre en langage naturel à des questions comme « Quels sont nos 10 clients les plus à risque de churn ce mois-ci ? » ou « Quel commercial a le meilleur ratio appels/signatures sur Q3 ? ». Les décisions de management s’appuient sur des données fraîches, sans passer par le service BI.

Génération de contenu et de rapports automatisés

Marketing, RH, finance : la génération automatique de rapports hebdomadaires, de newsletters internes ou de propositions commerciales personnalisées fait gagner 2 à 5 heures par semaine aux équipes concernées.

LangChain avec n8n et Make : le pont vers l’automatisation no-code

LangChain est un outil de développement — il requiert des compétences Python. Mais de nombreuses entreprises veulent bénéficier de la puissance des agents IA sans équipe de développement dédiée. C’est là qu’interviennent n8n et Make (ex-Integromat).

Ces plateformes d’automatisation no-code proposent des nœuds natifs pour appeler des chaînes LangChain via API. Le flux typique :

- Déclencheur (email entrant, formulaire Typeform, webhook Slack)

- Appel à un agent LangChain via API REST

- Traitement de la réponse (mise à jour CRM, envoi de notification, création de tâche)

Cette architecture hybride permet de combiner la puissance de raisonnement de LangChain avec la flexibilité des workflows visuels de n8n. Pour les PME, c’est souvent le meilleur point d’entrée : vous automatisez un premier processus en quelques jours, sans refonte de votre stack technique.

Coût et hébergement d’un agent LangChain en entreprise

C’est l’une des questions les plus fréquentes — et les moins bien documentées. Voici une estimation réaliste des coûts en 2026.

Coûts des LLMs (par million de tokens)

| Modèle | Coût input | Coût output | Souveraineté |

|---|---|---|---|

| GPT-4o (OpenAI) | ~2,50 $ | ~10 $ | ❌ Serveurs US |

| Claude 3.5 Sonnet (Anthropic) | ~3 $ | ~15 $ | ❌ Serveurs US |

| Mistral Large (API) | ~2 € | ~6 € | ✅ Serveurs EU |

| Mistral (on-premise) | Coût infra uniquement | — | ✅ Votre serveur |

| Llama 3 (open source) | Coût infra uniquement | — | ✅ Votre serveur |

Coûts d’infrastructure

- Hébergement cloud (AWS/OVH/Scaleway) : 200 à 800 €/mois pour un agent en production avec charge modérée

- Serveur dédié on-premise : investissement initial de 5 000 à 20 000 € (GPU), puis coûts d’électricité et maintenance

- Base vectorielle (Pinecone, Weaviate, pgvector) : 0 à 70 €/mois selon le volume

Coût total d’un projet LangChain en entreprise

| Scénario | Développement | Infra mensuelle | Total 1ère année |

|---|---|---|---|

| Agent simple (RAG + chat) | 10 000 – 20 000 € | 200 – 400 €/mois | ~15 000 – 25 000 € |

| Agent multi-outils (CRM + ERP) | 25 000 – 50 000 € | 400 – 800 €/mois | ~35 000 – 60 000 € |

| Plateforme multi-agents | 50 000 – 150 000 € | 800 – 2 000 €/mois | ~70 000 – 175 000 € |

Alternative : passer par une plateforme comme Agentsia.fr réduit significativement les coûts de développement en s’appuyant sur des agents préconfigurés et une infrastructure mutualisée.

Comment Agentsia.fr industrialise LangChain pour vous

Construire un agent LangChain from scratch nécessite des compétences en Python, en architecture cloud, en sécurité des données et en prompt engineering. Pour la grande majorité des entreprises françaises, constituer cette équipe en interne n’est ni réaliste ni souhaitable.

Agentsia.fr est une plateforme d’orchestration d’agents IA qui s’appuie sur LangChain et LangGraph pour proposer des agents prêts à l’emploi ou entièrement sur mesure, avec :

- Mémoire persistante : vos agents se souviennent de chaque interaction, de chaque client, de chaque décision — sans développement supplémentaire. En savoir plus sur la mémoire persistante des agents IA.

- Boucles de feedback : les agents s’améliorent en continu grâce aux retours de vos équipes, sans ré-entraînement du modèle

- Conformité RGPD : déploiement sur infrastructure française, données hébergées en France, contrat DPA inclus

- Intégration sans friction : connecteurs natifs pour vos outils existants (CRM, ERP, outils de ticketing)

- Accompagnement humain : une équipe d’experts vous accompagne de la définition du besoin au déploiement en production

Concrètement, là où un projet LangChain from scratch prend 3 à 6 mois, Agentsia.fr permet de déployer un premier agent opérationnel en 2 à 4 semaines.

FAQ

Qu’est-ce que LangChain en résumé ?

LangChain est un framework open source Python qui permet de construire des applications IA avancées en orchestrant des LLMs (GPT-4, Mistral, Claude) avec des outils, des bases de données et des sources de données externes. Il est utilisé pour créer des chatbots intelligents, des agents autonomes et des pipelines RAG en entreprise.

LangChain est-il gratuit ?

Oui, LangChain est open source et gratuit à utiliser. Les coûts proviennent des LLMs utilisés (facturation à l’usage par les fournisseurs comme OpenAI ou Mistral) et de l’infrastructure d’hébergement. Des offres commerciales existent via LangSmith (observabilité) et LangServe (déploiement).

Quelle est la différence entre LangChain et LangGraph ?

LangChain est le framework de base pour construire des applications LLM avec des chaînes et des agents. LangGraph est une extension de LangChain qui introduit une modélisation en graphe orienté, idéale pour les workflows complexes avec des boucles, des conditions et des points de validation humaine. Les deux sont complémentaires et développés par la même équipe.

LangChain est-il compatible avec le RGPD ?

LangChain en lui-même est un framework neutre. La conformité RGPD dépend de votre architecture : le LLM choisi (Mistral AI sur serveurs européens vs OpenAI sur serveurs américains), l’hébergement de votre infrastructure et la gestion des données personnelles. Combiné à Mistral AI et un hébergement français, LangChain peut s’inscrire dans une architecture pleinement conforme.

Comment démarrer avec LangChain en entreprise ?

La première étape est d’identifier un processus métier répétitif et bien documenté (FAQ support, analyse de documents, génération de rapports). Ensuite : choisir un LLM adapté à vos contraintes (souveraineté, coût, performance), prototyper un pipeline RAG simple, puis industrialiser avec une plateforme comme Agentsia.fr ou une équipe interne. Comptez 2 à 4 semaines pour un premier agent en production.