Craignez-vous que l’installation d’un chatbot rgpd france 2026 n’expose votre entreprise à des sanctions lourdes suite aux dernières directives de la CNIL et de l’AI Act ? Cet article vous explique comment sécuriser vos agents conversationnels en vous appuyant sur l’intérêt légitime pour garantir la confidentialité des échanges sans jamais sacrifier la performance opérationnelle. Vous découvrirez des méthodes techniques précises comme l’usage de données synthétiques ou la pseudonymisation pour protéger la vie privée de vos clients tout en maximisant votre rentabilité grâce à une transparence algorithmique et une gouvernance humaine parfaitement maîtrisées.

- Le cadre légal des chatbots en France pour 2026

- 3 méthodes pour protéger la confidentialité des échanges

- Comment gérer les droits des personnes avec l’IA générative ?

- Gouvernance et ROI des agents IA en entreprise

Le cadre légal des chatbots en France pour 2026

Après des années de flou, les règles du jeu pour l’intelligence artificielle en entreprise sont enfin limpides.

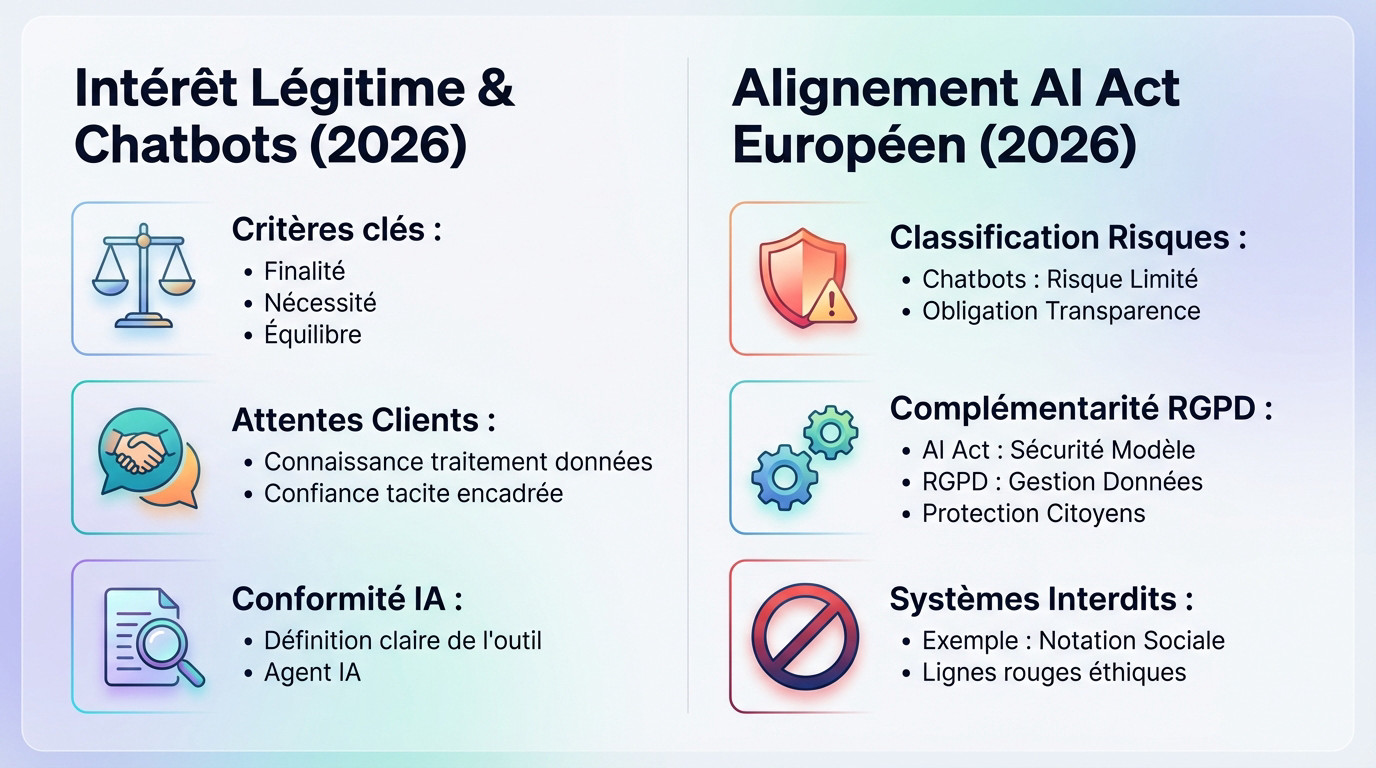

L’intérêt légitime au service du développement

Finalité, nécessité et équilibre définissent le socle de votre projet. Vous devez prouver que l’automatisation ne nuit pas à l’utilisateur. Utilisez l’intérêt légitime comme base légale solide pour déployer un agent. C’est la clé du succès.

Vos clients ont des attentes raisonnables. Ils comprennent qu’un robot traite leurs données pour répondre rapidement. Ce contrat de confiance tacite reste strictement encadré par la loi.

La conformité commence par une définition claire de l’outil. Consultez ce guide : Qu’est-ce qu’un agent IA | Guide expert et avis 2026. Une vision précise évite les erreurs juridiques.

L’alignement avec l’AI Act européen

La classification des risques de l’AI Act place souvent les chatbots en risque limité. Cette position impose une obligation de transparence immédiate. L’utilisateur doit savoir qu’il échange avec une machine.

Ce texte complète parfaitement le RGPD. L’AI Act surveille la sécurité du modèle technique et le RGPD protège les données personnelles. Les deux règlements protègent ensemble les citoyens français.

Certains systèmes comme la notation sociale restent strictement interdits. La France applique fermement ces exclusions éthiques. Aucun agent IA ne doit franchir ces lignes rouges sous peine de lourdes sanctions.

3 méthodes pour protéger la confidentialité des échanges

Une fois le cadre posé, il faut passer à la technique pour verrouiller les conversations.

L’anonymisation technique des flux de données

La pseudonymisation en temps réel s’impose pour votre chatbot rgpd france 2026. Les noms et numéros deviennent des jetons neutres instantanément. Vos données restent utiles sans être identifiantes pour autant.

Voici les actions concrètes à mener sur vos flux :

- Suppression des adresses IP

- Masquage des emails

- Nettoyage des métadonnées de connexion

- Hachage des identifiants uniques

Ces mesures protègent l’anonymat. Elles limitent les risques informatiques.

Le stockage sécurisé termine le travail. Les logs ne doivent conserver aucune trace sensible après passage. C’est la clé pour respecter la confidentialité des données de vos utilisateurs.

L’usage stratégique des données synthétiques

Les données synthétiques imitent parfaitement les comportements humains. Pourtant, elles ne contiennent aucune information personnelle réelle. Elles remplacent avantageusement les bases de données réelles trop risquées pour vos serveurs.

Ces clones numériques servent à l’entraînement des modèles. Cette méthode évite d’exposer la base client originale. La sécurité s’en trouve renforcée mécaniquement. On gagne en sérénité sans perdre en performance.

Pour la voix, la transcription audio profite aussi de cette approche. Des solutions souveraines garantissent cette étanchéité. L’humain reste protégé des algorithmes.

Comment gérer les droits des personnes avec l’IA générative ?

La protection technique est une chose, mais l’utilisateur garde toujours le contrôle final sur ses informations.

Le défi technique du droit à l’effacement

Regardons comment ces modèles mémorisent vos échanges. Les réseaux de neurones recracheront parfois des morceaux entiers de phrases apprises. C’est un vrai danger pour votre droit à l’oubli numérique avec un chatbot rgpd france 2026. Il faut surveiller ces fuites.

Installez des filtres robustes en sortie de chat. Bloquez systématiquement les informations personnelles avant qu’elles n’apparaissent à l’écran. Cette barrière de sécurité reste indispensable pour votre conformité.

Un modèle bien réglé ne stocke jamais de faits précis. Il saisit uniquement la structure du langage général. Évitez ainsi que votre outil ne devienne une base indiscrète.

La transparence des algorithmes de recommandation

Vos clients doivent savoir qu’ils parlent à une machine. Cette information claire fonde la loyauté algorithmique en 2026. Ne cachez jamais la nature robotique de votre agent conversationnel.

L’État multiplie désormais les campagnes de sensibilisation. Le but est d’aider chaque citoyen à mieux comprendre les outils numériques.

Expliquez simplement chaque décision de l’IA. Cette clarté évite les sanctions de la CNIL.

Intégrez ces éléments de transparence immédiatement pour rester dans les clous. Vous rassurez ainsi vos utilisateurs tout en respectant la loi actuelle. Voici les points à afficher obligatoirement sur votre interface dès aujourd’hui :

- Mention explicite de l’IA

- Accès aux paramètres de personnalisation

- Possibilité de contacter un humain

Gouvernance et ROI des agents IA en entreprise

Au-delà du droit, la conformité devient un levier de performance économique pour votre structure.

La supervision humaine pour valider les réponses

Le superviseur pilote l’intelligence artificielle au quotidien dans vos bureaux. La mise en place d’un chatbot rgpd france 2026 demande cette rigueur technique. L’humain valide les échanges complexes pour garantir la qualité.

Les modèles peuvent dévier avec le temps sans prévenir. Une surveillance régulière permet de rectifier le tir rapidement. Cela évite les erreurs factuelles graves. Vous corrigez ainsi les biais de manière proactive.

La responsabilité humaine demeure le pilier central de votre stratégie. En cas de litige, votre entreprise assume les décisions prises. L’IA reste un simple outil sous votre contrôle total.

L’intégration sécurisée aux outils métiers type CRM

L’agent IA consulte vos stocks et vos factures en temps réel. Ce couplage avec vos ERP exige une sécurité sans faille. L’étanchéité des API protège vos données sensibles. Maintenez une barrière technique robuste entre vos outils connectés.

Un système aux normes réduit drastiquement les risques de sanctions financières lourdes. La conformité génère un gain de temps immédiat. Vous transformez une contrainte légale en profit net pour l’entreprise.

Surveillez de près ces indicateurs pour mesurer votre succès :

- Taux de résolution automatique

- Réduction du temps de réponse

- Score de satisfaction client

- Économies sur les amendes RGPD

Maîtriser l’intérêt légitime et l’anonymisation technique garantit la pérennité de vos innovations. Intégrez dès aujourd’hui ces protocoles pour déployer des agents conversationnels conformes aux exigences françaises de 2026. Transformez cette mise en conformité en un levier de performance et de confiance durable.

FAQ

Quelle base légale devez-vous privilégier pour le déploiement de votre chatbot en 2026 ?

Pour vos projets d’intelligence artificielle, l’intérêt légitime constitue la base légale la plus adaptée, particulièrement lorsque le recueil du consentement s’avère complexe. Vous devez cependant valider trois critères essentiels : la licéité de la finalité, la nécessité du traitement et l’équilibre entre vos besoins commerciaux et les droits des utilisateurs. Assurez-vous que votre outil répond aux attentes raisonnables de vos clients pour maintenir ce contrat de confiance tacite.

Comment l’AI Act influence-t-il vos obligations de transparence ?

En 2026, la plupart des agents conversationnels sont classés dans la catégorie des systèmes à « risque limité » selon l’AI Act. Cette classification vous impose une obligation de transparence immédiate : vous devez impérativement informer vos interlocuteurs qu’ils interagissent avec une machine. Pour en savoir plus sur la mise en place de ces outils, consultez notre guide sur qu’est-ce qu’un agent IA afin de définir précisément le périmètre de votre solution.

Quelles méthodes techniques garantissent la confidentialité des échanges de vos utilisateurs ?

Vous devez intégrer des dispositifs de protection dès la conception, notamment par l’anonymisation ou la pseudonymisation en temps réel des flux de données. L’usage de données synthétiques est également recommandé pour affiner vos modèles sans exposer d’informations personnelles réelles. Pour vos besoins de transcription audio, privilégiez des solutions souveraines qui assurent une étanchéité totale de vos serveurs de calcul.

Comment pouvez-vous respecter le droit à l’effacement avec une IA générative ?

Le droit à l’oubli numérique représente un défi technique majeur puisque les modèles peuvent mémoriser certains fragments de données. Pour y répondre, mettez en place des filtres de sortie rigoureux qui bloquent la régurgitation d’informations personnelles avant leur affichage. Bien que le désapprentissage automatique soit une piste prometteuse, la gestion de la confidentialité repose avant tout sur un nettoyage strict des bases d’apprentissage et une limitation de la mémorisation des faits précis.

Pourquoi la supervision humaine est-elle indispensable à la conformité de votre agent IA ?

La responsabilité humaine reste le pilier de votre gouvernance pour valider les réponses et corriger d’éventuels biais algorithmiques. En gardant un expert dans la boucle, vous garantissez la qualité des interactions et assumez la maîtrise totale de l’outil face aux risques de dérives factuelles. Cette surveillance régulière transforme la conformité en un levier de performance, sécurisant ainsi votre retour sur investissement tout en évitant les sanctions du RGPD.